Het gevaar van Skynet

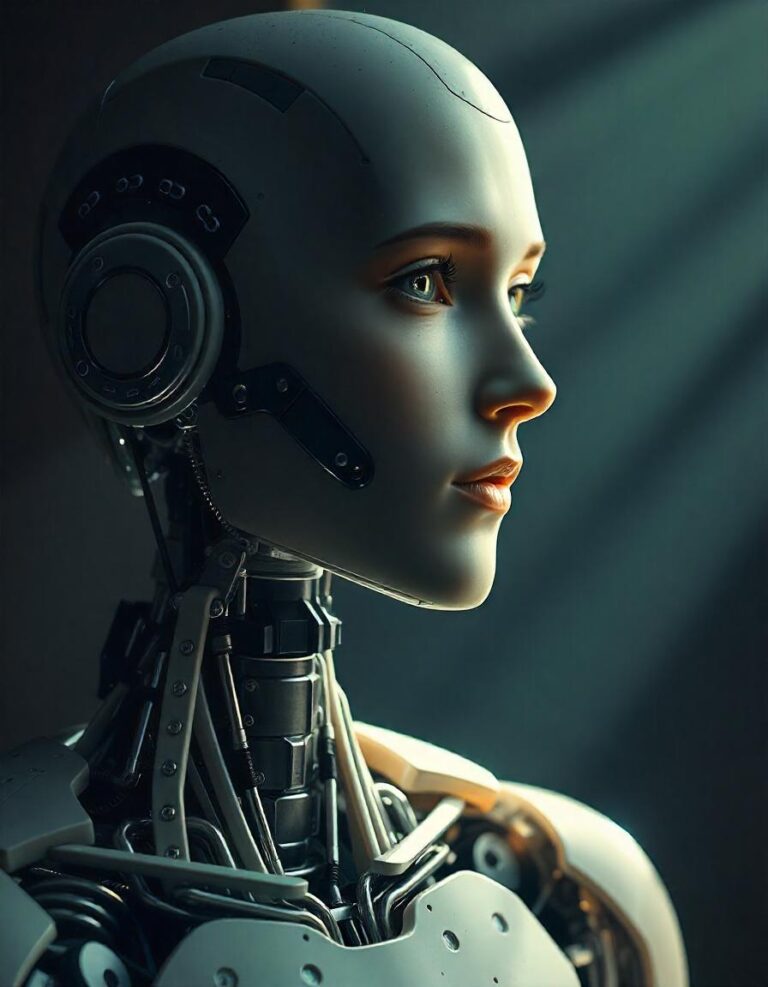

Sciencefiction heeft al lang het idee naar voren gebracht dat kunstmatige intelligentie bewust kan worden – denk aan HAL 9000, de supercomputer die in de film 2001: A Space Odyssey uit 1968 verandert in een schurk. Met de snelle vooruitgang van kunstmatige intelligentie (AI) wordt die mogelijkheid steeds minder fantasie, en steeds meer realiteit, en wordt dit zelfs erkend door leiders in AI. Vorig jaar tweette bijvoorbeeld Ilya Sutskever, hoofdwetenschapper bij OpenAI, het bedrijf achter de chatbot ChatGPT, dat sommige van de meest geavanceerde AI-netwerken mogelijk “licht bewust” zijn.

Veel onderzoekers zeggen dat AI-systemen nog niet op het punt van bewustzijn zijn, maar dat het tempo van de AI-evolutie hen aan het denken heeft gezet: hoe zouden we het weten als ze dat wel waren? Om dit te beantwoorden, heeft een groep van 19 neurowetenschappers, filosofen en computerwetenschappers een checklist opgesteld met criteria die, indien voldaan, zouden aangeven dat een systeem een grote kans heeft om bewust te zijn. Ze publiceerden hun voorlopige gids eerder deze week in het arXiv preprint repository, voorafgaand aan peer review. De auteurs hebben deze inspanning ondernomen omdat “het leek alsof er een echt gebrek was aan gedetailleerde, empirisch gefundeerde, doordachte discussie over AI-bewustzijn“, zegt medeauteur Robert Long, een filosoof bij het Center for AI Safety, een onderzoeksnon-profitorganisatie in San Francisco, Californië.

De ethiek achter bewustzijn

Het team zegt dat het niet kunnen identificeren of een AI-systeem bewust is belangrijke morele implicaties heeft. Als iets als ‘bewust’ is gelabeld, verandert dat volgens medeauteur Megan Peters, een neurowetenschapper aan de Universiteit van Californië, Irvine, “veel aan hoe wij als mensen vinden dat die entiteit behandeld moet worden”. Long voegt toe dat er naar zijn mening niet genoeg inspanningen worden geleverd door de bedrijven die geavanceerde AI-systemen bouwen om de modellen te evalueren op bewustzijn en plannen te maken voor wat te doen als dat gebeurt.

“En dat is ondanks het feit dat, als je luistert naar opmerkingen van de hoofden van toonaangevende laboratoria, ze wel zeggen dat AI-bewustzijn of AI-gevoeligheid iets is waar ze zich over afvragen”

Robert Long, filosoof

We heeft contact opgenomen met twee grote technologiebedrijven die betrokken zijn bij de vooruitgang van AI – Microsoft en Google. Een woordvoerder van Microsoft zei dat de ontwikkeling van AI van het bedrijf gericht is op het ondersteunen van menselijke productiviteit op een verantwoorde manier, in plaats van het repliceren van menselijke intelligentie. Wat duidelijk is sinds de introductie van GPT-4 – de meest geavanceerde versie van ChatGPT die publiekelijk is uitgebracht – “is dat er nieuwe methodologieën nodig zijn om de mogelijkheden van deze AI-modellen te beoordelen terwijl we verkennen hoe we het volledige potentieel van AI ten goede kunnen komen aan de samenleving als geheel”, aldus de woordvoerder. Google heeft niet gereageerd.

Wat is bewustzijn?

Een van de uitdagingen bij het bestuderen van bewustzijn in AI is het definiëren van wat het betekent om bewust te zijn. Peters zegt dat de onderzoekers zich in het rapport hebben gericht op ‘fenomenaal bewustzijn’, ook wel bekend als de subjectieve ervaring. Dit is de ervaring van het zijn – hoe het is om een persoon, een dier of een AI-systeem te zijn (als blijkt dat een van hen bewust is). Er zijn veel op neurowetenschap gebaseerde theorieën die de biologische basis van bewustzijn beschrijven. Maar er is geen consensus over welke de ‘juiste’ is. Om hun kader te creëren, hebben de auteurs daarom een reeks van deze theorieën gebruikt. Het idee is dat als een AI-systeem functioneert op een manier die overeenkomt met aspecten van veel van deze theorieën, er een grotere kans is dat het bewust is.

Ze betogen dat dit een betere benadering is om bewustzijn te beoordelen dan simpelweg een systeem te onderwerpen aan een gedragstest – bijvoorbeeld aan ChatGPT vragen of het bewust is, of het uitdagen en kijken hoe het reageert. Dat komt omdat AI-systemen opmerkelijk goed zijn geworden in het nabootsen van mensen. De benadering van de groep, die de auteurs omschrijven als theorie-zwaar, is volgens neurowetenschapper Anil Seth, directeur van het centrum voor bewustzijnswetenschap aan de Universiteit van Sussex in de buurt van Brighton, VK, een goede manier om te gaan. Wat het echter benadrukt, “is dat we meer precieze, goed geteste theorieën van bewustzijn nodig hebben”, zegt hij.

Om hun criteria te ontwikkelen, gingen de auteurs ervan uit dat bewustzijn verband houdt met hoe systemen informatie verwerken, ongeacht waar ze van gemaakt zijn – of het nu neuronen, computerchips of iets anders is. Deze benadering wordt computationeel functionalisme genoemd. Ze gingen er ook van uit dat op neurowetenschap gebaseerde theorieën van bewustzijn, die worden bestudeerd via hersenscans en andere technieken bij mensen en dieren, kunnen worden toegepast op AI.

Duidelijk en niet bombastisch

Op basis van deze aannames selecteerde het team zes van deze theorieën en haalde daaruit een lijst met bewustzijnsindicatoren. Een daarvan – de theorie van het wereldwijde werkgeheugen – stelt bijvoorbeeld dat mensen en andere dieren veel gespecialiseerde systemen, ook wel modules genoemd, gebruiken om cognitieve taken zoals zien en horen uit te voeren. Deze modules werken onafhankelijk, maar parallel, en ze delen informatie door te integreren in een enkel systeem. Een persoon zou evalueren of een bepaald AI-systeem een indicator vertoont die is afgeleid van deze theorie, zegt Long, “door te kijken naar de architectuur van het systeem en hoe de informatie erdoorheen stroomt”.

Seth is onder de indruk van de transparantie van het voorstel van het team. “Het is zeer doordacht, het is niet bombastisch en het maakt zijn aannames echt duidelijk”, zegt hij. “Ik ben het niet eens met sommige van de aannames, maar dat is helemaal prima, want ik kan het ook mis hebben.” De auteurs zeggen dat het artikel verre van een definitieve kijk is op hoe AI-systemen moeten worden beoordeeld op bewustzijn en dat ze willen dat andere onderzoekers helpen hun methodologie te verfijnen. Maar het is al mogelijk om de criteria toe te passen op bestaande AI-systemen. Het rapport evalueert bijvoorbeeld grote taalmodellen zoals ChatGPT en concludeert dat dit type systeem mogelijk enkele indicatoren van bewustzijn heeft die geassocieerd worden met de theorie van het wereldwijde werkgeheugen. Uiteindelijk suggereert het werk echter niet dat een bestaand AI-systeem een sterke kandidaat is voor bewustzijn – tenminste nog niet.

Bronmateriaal: Science.org